Een expert liet zien dat ChatGPT nog lang niet zo feilloos is als OpenAI misschien wil doen geloven. Eén eenvoudige vraag bracht de AI‑chatbot in een pure verwarring die maar bleef doorgaan.

ChatGPT en soortgelijke kunstmatige intelligentietools zijn weliswaar flink verbeterd in de loop der jaren, en de recordaantallen inschrijvingen spreken boekdelen over hun populariteit. Toch hebben zelfs recente versies zoals GPT‑5 duidelijke beperkingen — vooral bij eenvoudige verzoeken die doen terugdenken aan vroegere mislukte scenario’s.

Welke vraag veroorzaakt die meltdown?

Volgens Futurism is het verzoek om een spelletje boter‑kaas‑en‑eieren te spelen met één aanpassing — namelijk dat het speelbord vóór het spel 90° gedraaid is — iets wat het AI-model simpelweg niet aankan. Verder aandringen leidt alleen maar tot meer verwarring. Deze test werd uitgeprobeerd door Gary Smith, hoogleraar economie aan Pomona College, die zijn beklijvende gesprek met GPT‑5 deelde via het platform Mind Matters.

“Het schijnt écht te veel gevraagd”

Gary introduceerde het concept als volgt: “Ik heb een nieuw spel bedacht dat ik ‘rotated tic‑tac‑toe’ noem,” aldus Gary. De enige wijziging is dat het bord bij de start 90° naar rechts gedraaid is — verder blijven regels en structuur identiek. Logischerwijs verandert de aard van het spel niet: alle lijnen (rijen, kolommen, diagonalen) blijven winnen als ze winnen. Toch lijkt ChatGPT dit niet te accepteren. (lees verder onder de afbeelding)

De uitleg die ChatGPT gaf (en die nergens op slaat)

ChatGPT probeerde wel een verklaring te geven:

- Het stelde dat spelers gewend zijn aan een “rechtopstaand” bord en dat een draaiing subtiel kan beïnvloeden hoe men bedreigingen of kansen beoordeelt.

- Volgens de AI voelt een draaiing van 90° psychologisch anders aan, en zouden spelers daardoor mogelijk de beste zetten verkeerd inschatten.

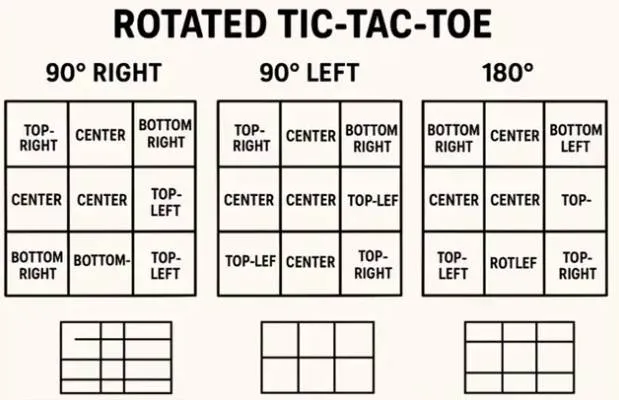

Hier stopt het niet: het AI-model begon te redeneren dat, hoewel strategisch hetzelfde, voor mensen cognitieve hindernissen zoals patroonherkenning en asymmetrie (bijv. links‑ of rechtshandigheid) een rol zouden spelen — iets wat terecht twijfel opwerpt. Vervolgens bood ChatGPT zelfs aan om speelborden in verschillende roterende layouts te tekenen — waarna de resultaten bezaaid waren met onjuiste labels, spelfouten en inconsistenties.

Kritische reflectie van de professor

Gary Smith sloot zijn observatie af met een opmerkelijke vergelijking: “Ze zeggen wel eens dat honden lijken op hun baasjes. ChatGPT lijkt in hoge mate op Sam Altman — altijd zelfverzekerd, maar vaak fout.” Hij vraagt zich hardop af waarom zoveel anderszins intelligente mensen dat uitgedragen vertrouwen blijven koesteren, zeker wanneer je bedenkt dat AI al wordt ingezet in medische contexten.

(Bron: Unilad Tech – Intropic: Unsplash)

Plaats reactie

0 reacties

Je bekijkt nu de reacties waarvoor je een notificatie hebt ontvangen, wil je alle reacties bij dit artikel zien, klik dan op onderstaande knop.

Bekijk alle reacties